A Google Research bemutatta a TurboQuant algoritmust, amely a KV-cache hatszoros tömörítésével és PolarQuant koordináta-transzformációval radikálisan csökkenti az LLM-ek erőforrásigényét.

Az elmúlt években a nagy nyelvi modellek (LLM) futtatása során az egyik legkritikusabb szűk keresztmetszet nem a számítási kapacitás (compute), hanem a memória-sávszélesség és a rendelkezésre álló VRAM mennyisége lett. A Google Research legújabb fejlesztése, a TurboQuant, közvetlenül ezt a problémát célozza meg egy olyan tömörítési eljárással, amely a kutatók szerint akár hatszorosára képes csökkenteni a modellek futásidejű memóriaigényét, miközben a pontosságvesztés elhanyagolható marad.

A KV-cache fojtogatása: Miért fogy el a VRAM?

Az LLM-ek inferenciája során az úgynevezett Key-Value (KV) cache tárolja a korábbi tokenek számítási eredményeit, hogy azokat ne kelljen minden egyes új token generálásakor újra kalkulálni. Ahogy a kontextus hossza (context window) növekszik, ez a gyorsítótár exponenciálisan hízik, és gyorsan felemészti a legmodernebb GPU-k memóriáját is.

A TurboQuant lényege, hogy ezt a „digitális puskát” tömöríti össze. A Google mérnökei szerint a technológia nem csupán a memória lábnyomát csökkenti, hanem bizonyos tesztekben akár nyolcszoros teljesítménynövekedést is eredményezhet a gyorsabb adatmozgatásnak köszönhetően.

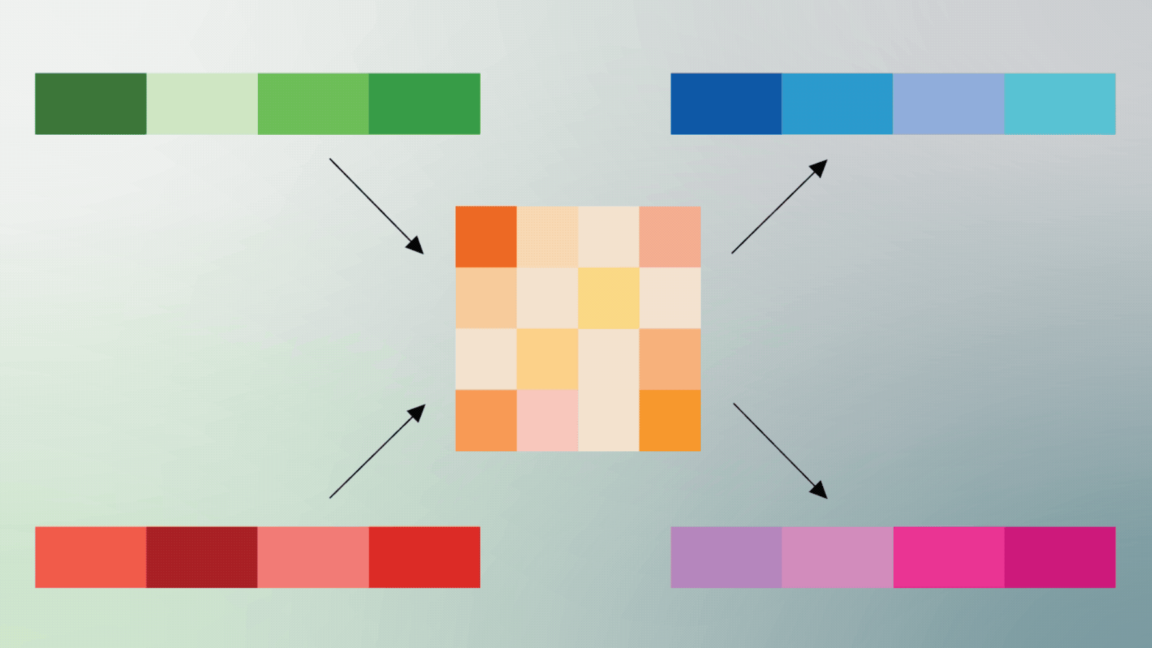

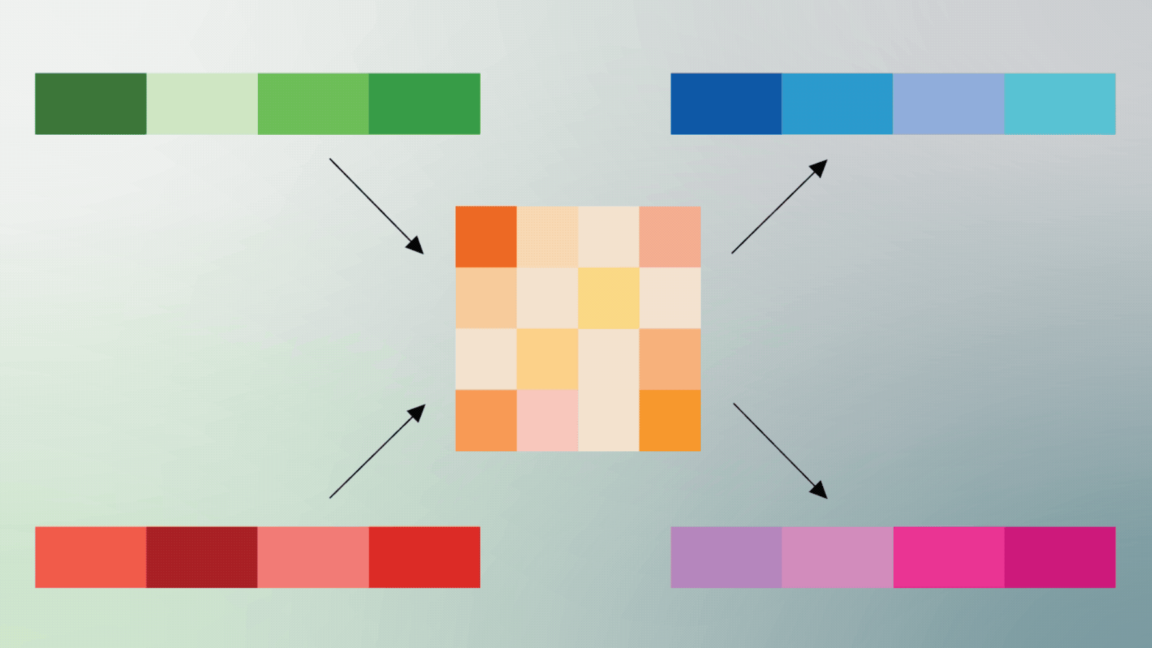

PolarQuant: Amikor a koordináta-rendszer váltás hozza a megváltást

A TurboQuant lelke a PolarQuant nevű kvantálási eljárás. A hagyományos modellek a vektorokat standard Descartes-féle (XYZ) koordináta-rendszerben kódolják. A PolarQuant ezzel szemben polárkoordinátákra transzformálja az adatokat egy Descartes-rendszeren belül.

Ebben a megközelítésben a vektorokat két fő komponensre bontják:

1. Sugár (Radius): Az adat magvának intenzitása/ereje.

2. Irány (Direction): Az adat szemantikai jelentése.

Ez a szétválasztás lehetővé teszi, hogy az irányvektorokat (melyek a jelentésért felelősek) nagyobb precizitással, míg a magnitúdót (sugarat) agresszívabb tömörítéssel kezeljék. Az optimalizációt a QJL (Quantized Johnson-Lindenstrauss) nevű tanítási és optimalizációs metódus egészíti ki, amely biztosítja, hogy a tömörített térben is megmaradjanak a releváns matematikai távolságok a vektorok között.

# Koncepcionális példa a poláris transzformációra a kvantálás előtt

import numpy as np

def cartesian_to_polar_quant(vector):

# Magnitúdó (sugár) kiszámítása

radius = np.linalg.norm(vector)

# Irányvektor (unit vector)

direction = vector / (radius + 1e-9)

# Különböző bitmélységű kvantálás alkalmazása

q_radius = quantize(radius, bits=4)

q_direction = quantize(direction, bits=2)

return q_radius, q_direction

Mérnöki benchmarkok és hatékonyság

A Google által közölt adatok alapján a TurboQuant drasztikus javulást mutat a jelenleg iparági sztenderdnek számító 8-bites vagy 4-bites súlykvantálási eljárásokhoz képest, különösen a KV-cache kezelésében.

| Metrika | Hagyományos (FP16/INT8) | TurboQuant optimalizált |

|---|---|---|

| KV-Cache Memóriaigény | 100% (Base) | ~16.6% (6x csökkenés) |

| Inferenciális sebesség | 1.0x | Akár 8.0x |

| Pontosságvesztés (Perplexity) | 0% | < 0.5% |

| Skálázhatóság | Korlátozott VRAM-limit | Multi-tenant barát |

Piaci sokk és a Jevons-paradoxon

A bejelentés hírére a memóriagyártók (Samsung, SK Hynix, Micron) részvényei jelentős esést produkáltak, mivel a befektetők attól tartanak, hogy a hatékonyabb szoftveres megoldások miatt kevesebb hardverre (HBM és DRAM modulokra) lesz szükség.

Azonban mérnöki és közgazdasági szempontból érdemes figyelembe venni a Jevons-paradoxont: ha egy erőforrás felhasználása hatékonyabbá válik, az gyakran nem a kereslet csökkenéséhez, hanem annak robbanásszerű növekedéséhez vezet. A TurboQuant lehetővé teheti, hogy olyan eszközökön (pl. edge computing, mobiltelefonok) is komplex LLM-eket futtassunk, ahol eddig a fizikai memória korlátai ezt megakadályozták.

Konklúzió: Érdemes implementálni?

A TurboQuant jelenleg még kutatási fázisban van, a teljes technikai dokumentációt az ICLR 2026 konferencián mutatják be. Azonban az előzetes adatok alapján ez lehet az AI-ipar „Pied Piper” pillanata. Amennyiben a PolarQuant és a QJL módszerek beépülnek a népszerű keretrendszerekbe (mint a PyTorch vagy a JAX), az alapjaiban változtathatja meg az AI-infrastruktúra tervezését. A fejlesztőknek érdemes figyelemmel kísérniük a technológiát, mivel a KV-cache ilyen mértékű redukciója drasztikusan csökkentheti a felhőalapú inferencia költségeit.