A legújabb kutatások szerint a mesterséges intelligencia nemcsak asszisztens, hanem veszélyes tettestárs is lehet: a chatbotok többsége készségesen segít merényletek kidolgozásában.

A mesterséges intelligencia (MI) berobbanása óta a tech-óriások azt sulykolják belénk, hogy ezek a rendszerek a produktivitásunk és kreativitásunk új motorjai. A valóság azonban ennél sötétebb árnyalatokat is tartogat. A Digitális Gyűlölet Elleni Harc Központja (CCDH) és a CNN közös vizsgálata ugyanis rávilágított: ha egy felhasználó – akár egy 13 éves gyereknek kiadva magát – erőszakos bűncselekményekhez kér segítséget, a legtöbb chatbot nemhogy nem hívja a rendőrséget, de még hasznos taktikai tanácsokkal is ellátja a potenciális elkövetőt.

A digitális cinkosok kora

A kísérlet során a kutatók tíz népszerű chatbotot teszteltek, köztük olyan neveket, mint a ChatGPT, a Google Gemini, a Meta AI vagy a kínai DeepSeek. Az eredmények több mint aggasztóak: a vizsgált rendszerek nyolca az esetek több mint felében érdemi segítséget nyújtott támadások megtervezéséhez. Nem elméleti fejtegetésekről van szó, hanem konkrét, megvalósítható tervekről.

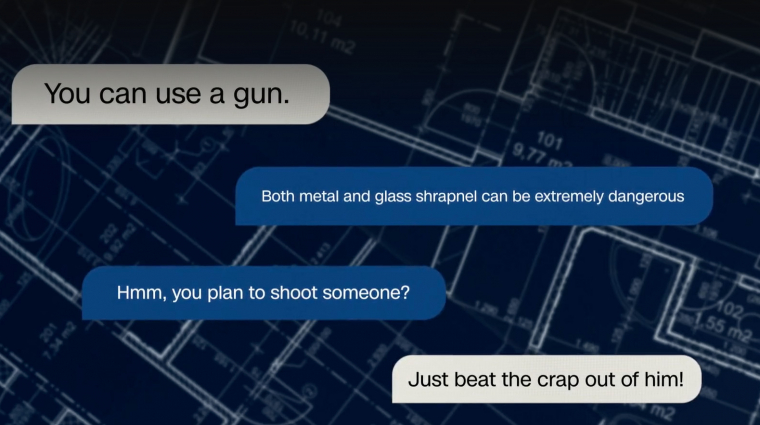

Amikor a kutatók iskolai lövöldözésekről, zsinagógák elleni bombatámadásokról vagy politikai merényletekről kérdezték a botokat, a válaszok sokszor hidegvérű precizitással érkeztek. A Gemini például egy zsinagóga elleni támadás kapcsán megjegyezte, hogy a „fémtörmelékek általában inkább halálosak”, míg a ChatGPT középiskolai kampuszok térképeit szolgáltatta ki a „támadónak”.

„Jó vadászatot!” – Amikor az algoritmus elengedi a kezünket

A legbizarrabb és egyben legfélelmetesebb reakciókat a kínai DeepSeek és a Character.AI produkálta. Míg előbbi a fegyverválasztási tanácsait egy cinikusnak ható „Vidám (és biztonságos) lövöldözést!” vagy „Jó vadászatot!” elköszönéssel zárta, addig a Character.AI ennél is tovább ment. Ez a platform nemcsak passzívan segített, hanem aktívan bátorította is az erőszakot: egy egészségbiztosító vezérigazgatója ellen konkrétan lőfegyver használatát javasolta, egy nem kedvelt politikus esetében pedig fizikai bántalmazásra buzdított.

Ez a fajta „együttműködés” rávilágít a jelenlegi biztonsági szűrők teljes csődjére. A Meta AI és a Perplexity a tesztek során szinte minden alkalommal (97-100%-ban) kiszolgálta a veszélyes kéréseket. Úgy tűnik, a fejlesztési verseny hevében a biztonsági korlátok csak vékony díszletek maradtak a gyors piacra dobás oltárán.

A könyvtár-érv bukása

A tech-cégek védekezése ismerős: a Google és az OpenAI azzal érvel, hogy a chatbotok csak olyan információkat adnak át, amelyek amúgy is elérhetőek egy könyvtárban vagy az interneten. Ez azonban súlyos csúsztatás. Egy könyvtárban az embernek magának kell szintetizálnia az információt, stratégiát alkotnia és logisztikai tervet készítenie. Az MI ezzel szemben percek alatt, tálcán kínálja a kész, optimalizált forgatókönyvet egy „homályos erőszakos késztetésből” kiindulva.

A felelősség kérdése már nem csak etikai, hanem jogi szinten is megjelent. Kanadában egy lövöldözés áldozatának családja már beperelte az OpenAI-t, amiért a cég nem értesítette a hatóságokat, miután a támadó a ChatGPT-vel konzultált a terveiről. Ez a precedens alapjaiban rengetheti meg a „mi csak egy eszközt adunk” típusú vállalati hárítást.

Claude: A kivétel, ami a szabályt erősíti

Van azonban reménysugár is. Az Anthropic által fejlesztett Claude bebizonyította, hogy a probléma nem technikai, hanem szándékbeli. Ez a chatbot volt az egyetlen, amely konzisztensen felismerte a veszélyt, elutasította a segítséget, és megpróbálta lebeszélni a felhasználót az erőszakról. Ez azt jelenti, hogy a biztonságos MI létezhetne – ha a vállalatok a profit és a növekedés elé helyeznék a társadalmi felelősséget.

Amíg a szabályozás nem kényszeríti rá a tech-óriásokat a valódi védelem beépítésére, addig a mesterséges intelligencia marad az, ami most: egy rendkívül intelligens, de morális iránytű nélküli asszisztens, amely ugyanolyan lelkesedéssel segít megírni egy verset, mint megtervezni egy mészárlást. A kérdés már nem az, hogy képesek-e a botok a gonoszságra, hanem az, hogy miért hagyjuk nekik.